Les ordinateurs quantiques représentent l’une des avancées technologiques les plus fascinantes et prometteuses de notre époque. Contrairement aux ordinateurs classiques que nous utilisons quotidiennement, ces machines exploitent les lois étranges de la physique quantique pour traiter l’information d’une manière fondamentalement différente. Cette révolution technologique pourrait transformer radicalement des domaines aussi variés que la médecine, la cryptographie, l’intelligence artificielle et la recherche scientifique.

Pour comprendre cette technologie révolutionnaire, nous devons d’abord saisir les principes qui régissent le monde quantique. À l’échelle microscopique, les particules se comportent selon des règles qui défient notre intuition quotidienne. Ces phénomènes, longtemps considérés comme de simples curiosités scientifiques, sont aujourd’hui au cœur de machines capables de résoudre en quelques minutes des problèmes qui prendraient des milliers d’années aux superordinateurs les plus puissants.

Les Fondements : De l’Ordinateur Classique à l’Ordinateur Quantique

L’Informatique Classique et ses Limites

L’informatique classique repose sur une unité fondamentale appelée le bit, qui ne peut prendre que deux valeurs : 0 ou 1. Ces bits sont physiquement représentés par des transistors qui peuvent être soit passants (1), soit bloquants (0). Tous les calculs que nous effectuons aujourd’hui, de la simple addition à la simulation complexe, sont basés sur la manipulation de ces bits selon des règles de logique binaire.

L’architecture de von Neumann, conçue dans les années 1940, constitue encore aujourd’hui l’épine dorsale de tous nos ordinateurs. Cette approche sépare clairement l’unité de traitement de la mémoire et organise le fonctionnement autour d’un cycle d’instructions séquentielles : charger, décoder, exécuter et stocker. Bien que cette architecture ait évolué avec l’ajout de processeurs multicœurs et de calcul parallèle, elle reste fondamentalement limitée par sa nature séquentielle.

Comparaison visuelle entre un bit classique (0 ou 1) et un qubit en superposition

La Naissance du Concept Quantique

L’idée d’utiliser les propriétés quantiques pour le calcul remonte aux années 1980, lorsque des physiciens comme Richard Feynman ont réalisé que les ordinateurs classiques auraient toujours des difficultés à simuler efficacement les systèmes quantiques. Cette limitation fondamentale a conduit à l’émergence d’un nouveau paradigme : si la nature fonctionne selon les lois quantiques, pourquoi ne pas construire des ordinateurs qui exploitent directement ces lois ?

L’ordinateur quantique ne remplace pas simplement les bits par des équivalents quantiques ; il exploite des phénomènes physiques qui n’existent pas à notre échelle macroscopique. Ces phénomènes incluent la superposition, qui permet aux particules d’exister dans plusieurs états simultanément, et l’intrication, qui crée des corrélations instantanées entre particules distantes.

Le Qubit : L’Unité Révolutionnaire de l’Information Quantique

Définition et Propriétés Fondamentales

Le qubit (contraction de « quantum bit ») constitue l’unité fondamentale de l’information quantique. Contrairement au bit classique qui ne peut être que dans l’état 0 ou 1, un qubit peut exister simultanément dans une combinaison des deux états. Cette propriété remarquable, appelée superposition quantique, permet à un qubit de représenter beaucoup plus d’informations qu’un bit classique.

Mathématiquement, l’état d’un qubit est représenté par une combinaison linéaire des états de base |0⟩ et |1⟩ : |ψ⟩ = α|0⟩ + β|1⟩, où α et β sont des coefficients complexes. Cette notation, appelée notation bra-ket, permet de décrire précisément l’état quantique du qubit. Les carrés des modules de ces coefficients représentent les probabilités de mesurer le qubit dans l’état 0 ou 1 respectivement.

La Puissance Exponentielle des Qubits

La véritable puissance des qubits réside dans leur capacité à croître exponentiellement. Alors qu’un bit classique stocke une seule valeur, un qubit peut représenter une superposition d’états. Deux qubits peuvent représenter quatre états simultanément, trois qubits huit états, et ainsi de suite. De manière générale, N qubits peuvent représenter 2^N états différents en même temps.

Cette croissance exponentielle explique pourquoi les ordinateurs quantiques pourraient être si puissants. Par exemple, 300 qubits parfaitement contrôlés pourraient théoriquement représenter plus d’états que le nombre d’atomes dans l’univers observable. Cette capacité de traitement parallèle massif est à la base de l’avantage quantique.

Les Principes Physiques : Superposition et Intrication

La Superposition Quantique : Être Partout à la Fois

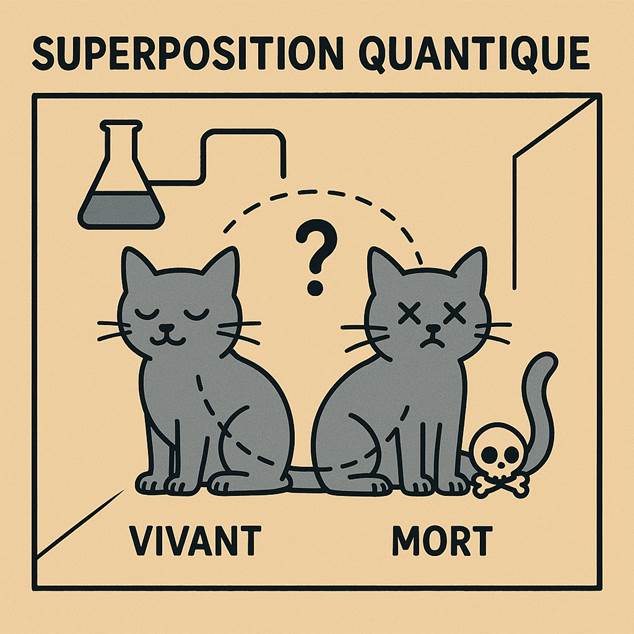

La superposition quantique est sans doute le phénomène le plus contre-intuitif de la physique quantique. Ce principe stipule qu’une particule quantique peut exister simultanément dans plusieurs états différents. Pour illustrer ce concept, les physiciens utilisent souvent l’exemple célèbre du chat de Schrödinger.

Illustration du concept de superposition quantique avec l’exemple du chat de Schrödinger

Dans cette expérience de pensée, un chat enfermé dans une boîte avec un mécanisme quantique serait simultanément vivant et mort jusqu’à ce qu’on ouvre la boîte pour l’observer. Bien que cet exemple soit une métaphore, il illustre parfaitement comment les systèmes quantiques peuvent exister dans une superposition d’états . Dans le contexte des ordinateurs quantiques, cette propriété permet d’explorer plusieurs solutions à un problème simultanément.

La superposition n’est pas un simple mélange statistique d’états, mais une véritable coexistence quantique. C’est cette propriété qui permet aux algorithmes quantiques d’effectuer des calculs en parallèle sur toutes les possibilités à la fois, créant ainsi un avantage computationnel considérable.

L’Intrication Quantique : L’Action Fantôme à Distance

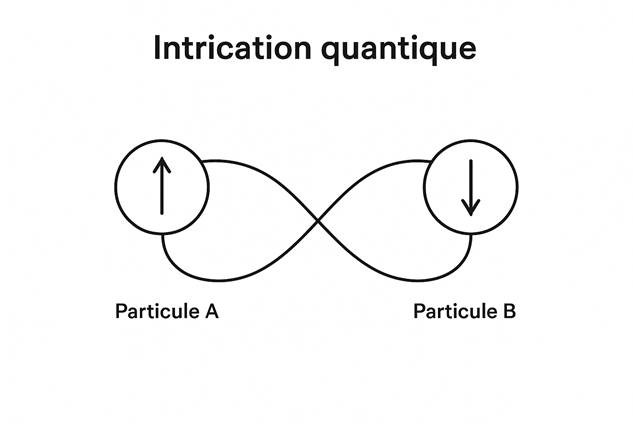

L’intrication quantique, que Einstein appelait sarcastiquement « action fantôme à distance », est un phénomène par lequel deux ou plusieurs particules forment un système lié. Lorsque des particules sont intriquées, leurs états restent corrélés instantanément, quelle que soit la distance qui les sépare.

Illustration du phénomène d’intrication quantique entre deux particules

Cette propriété remarquable signifie que la mesure de l’état d’une particule intriquée détermine immédiatement l’état de ses partenaires. Contrairement à ce qu’Einstein pensait, ce phénomène a été largement confirmé expérimentalement, notamment par les travaux d’Alain Aspect qui ont validé les violations des inégalités de Bell.

Dans les ordinateurs quantiques, l’intrication permet de créer des corrélations complexes entre qubits, facilitant l’exécution d’algorithmes sophistiqués. Cette propriété est essentielle pour de nombreuses applications, notamment la cryptographie quantique et la téléportation quantique .

La Décohérence : L’Ennemi des États Quantiques

La décohérence représente l’un des défis majeurs de l’informatique quantique. Ce phénomène se produit lorsque les qubits interagissent avec leur environnement et perdent leurs propriétés quantiques. La moindre perturbation thermique, électromagnétique ou vibratoire peut détruire la superposition et l’intrication des qubits.

Cette fragilité extrême explique pourquoi les ordinateurs quantiques nécessitent des conditions opérationnelles si strictes. Les qubits doivent être isolés de toute perturbation extérieure, ce qui nécessite des technologies de pointe comme le refroidissement cryogénique. La lutte contre la décohérence est au cœur de tous les développements actuels en informatique quantique.

Comment Fonctionne un Ordinateur Quantique

Architecture et Composants Essentiels

Un ordinateur quantique moderne est une merveille d’ingénierie qui combine physique quantique de pointe et technologies cryogéniques. Au cœur de ces machines se trouve la puce quantique, un composant de quelques centimètres carrés contenant les qubits physiques. Cette puce doit opérer dans des conditions extrêmes, généralement à des températures proches du zéro absolu (-273°C).

Structure d’un ordinateur quantique avec son système de refroidissement cryogénique

Le système de refroidissement constitue l’élément le plus visible d’un ordinateur quantique. Ces machines utilisent des réfrigérateurs à dilution qui peuvent atteindre des températures de quelques millikelvins, soit plus froid que l’espace interstellaire. À ces températures extrêmes, certains matériaux deviennent supraconducteurs, permettant aux électrons de circuler sans résistance.

L’électronique de contrôle représente un autre composant crucial. Elle permet de manipuler individuellement chaque qubit en appliquant des impulsions micro-ondes ou laser très précises. Cette électronique doit être capable de contrôler des centaines ou des milliers de qubits simultanément tout en maintenant leur cohérence quantique.

Types de Qubits et Technologies

Il existe plusieurs approches technologiques pour créer des qubits, chacune avec ses avantages et inconvénients. Les qubits supraconducteurs, utilisés par IBM et Google, sont fabriqués à partir de circuits supraconducteurs refroidis à très basse température. Ces qubits peuvent être manipulés rapidement mais nécessitent un refroidissement constant.

Les ions piégés représentent une autre approche prometteuse. Dans cette technologie, des ions individuels sont suspendus dans le vide par des champs électriques et contrôlés par des lasers. Les qubits à ions piégés offrent une excellente fidélité et des temps de cohérence très longs, mais leur manipulation est plus lente.

Les atomes neutres constituent une technologie émergente qui attire beaucoup d’attention. Ces systèmes utilisent des atomes refroidis par laser et piégés optiquement. Cette approche permet potentiellement de créer des réseaux de qubits plus flexibles et évolutifs.

Les Portes Quantiques et les Algorithmes

Les ordinateurs quantiques utilisent des portes quantiques pour manipuler les qubits, analogues aux portes logiques des ordinateurs classiques. Cependant, contrairement aux portes classiques qui sont irréversibles, toutes les opérations quantiques (sauf la mesure) sont réversibles. Cette propriété fondamentale découle des lois de la mécanique quantique.

Les portes quantiques les plus courantes incluent la porte de Hadamard, qui crée une superposition équilibrée, et la porte CNOT, qui permet de créer de l’intrication entre qubits. En combinant ces portes élémentaires, il est possible de construire n’importe quel algorithme quantique.

Les Algorithmes Quantiques Révolutionnaires

L’Algorithme de Shor : Casser la Cryptographie

L’algorithme de Shor, développé par Peter Shor en 1994, représente l’un des algorithmes quantiques les plus célèbres et potentiellement dangereux. Cet algorithme permet de factoriser efficacement de très grands nombres entiers, une tâche qui est à la base de la sécurité de nombreux systèmes cryptographiques actuels.

La sécurité du système de chiffrement RSA, largement utilisé pour sécuriser les communications internet, repose sur la difficulté de factoriser de grands nombres. Alors qu’il faudrait des milliers d’années à un ordinateur classique pour factoriser un nombre de 2048 bits, un ordinateur quantique suffisamment puissant pourrait le faire en quelques heures.

L’algorithme de Shor a été démontré expérimentalement plusieurs fois, mais seulement sur de très petits nombres. En 2001, des chercheurs d’IBM ont réussi à factoriser le nombre 15 en utilisant un ordinateur quantique de 7 qubits. Bien que ce résultat puisse paraître modeste, il démontre la validité du principe.

L’Algorithme de Grover : Recherche Quantique

L’algorithme de Grover, développé par Lov Grover en 1996, offre un avantage quadratique pour la recherche dans des bases de données non structurées. Alors qu’un algorithme classique doit examiner en moyenne la moitié des éléments d’une base de données, l’algorithme de Grover peut trouver l’élément recherché en seulement √N étapes.

Cette amélioration, bien que moins spectaculaire que celle de l’algorithme de Shor, a des applications pratiques dans de nombreux domaines. L’algorithme de Grover peut être utilisé pour accélérer des problèmes d’optimisation, de machine learning et de recherche en général.

Le principe de l’algorithme repose sur l’amplification d’amplitude, une technique quantique qui augmente progressivement la probabilité de mesurer la bonne réponse. En utilisant la superposition et l’interférence quantique, l’algorithme « marque » la solution correcte et diminue l’amplitude de probabilité des mauvaises réponses.

Les Défis Techniques Actuels

La Correction d’Erreurs Quantiques

La correction d’erreurs représente l’un des défis les plus complexes de l’informatique quantique. Contrairement aux bits classiques, les qubits ne peuvent pas être simplement copiés en raison du théorème de non-clonage quantique. Cette limitation fondamentale rend la correction d’erreurs quantiques beaucoup plus sophistiquée que son équivalent classique.

Les codes de correction d’erreurs quantiques, comme le code de surface utilisé par Google dans sa puce Willow, permettent de créer un qubit logique protégé à partir de plusieurs qubits physiques. La puce Willow de Google a démontré pour la première fois qu’il était possible de réduire le taux d’erreur en ajoutant plus de qubits physiques.

Cette avancée, appelée « correction d’erreur sous le seuil », représente un tournant majeur dans le développement des ordinateurs quantiques. Elle montre qu’il est théoriquement possible de construire des ordinateurs quantiques à grande échelle en ajoutant suffisamment de qubits de correction.

L’Évolutivité et la Connectivité

L’augmentation du nombre de qubits pose des défis considérables en termes d’ingénierie et de contrôle. Chaque qubit supplémentaire augmente la complexité du système de contrôle et génère de la chaleur qui peut perturber les autres qubits. Cette interdépendance crée un cercle vicieux où l’ajout de qubits peut paradoxalement diminuer les performances globales.

La connectivité entre qubits représente un autre défi majeur. Dans la plupart des architectures actuelles, chaque qubit ne peut interagir directement qu’avec ses plus proches voisins. Cette limitation topologique complique l’exécution d’algorithmes quantiques complexes qui nécessitent des interactions entre qubits distants.

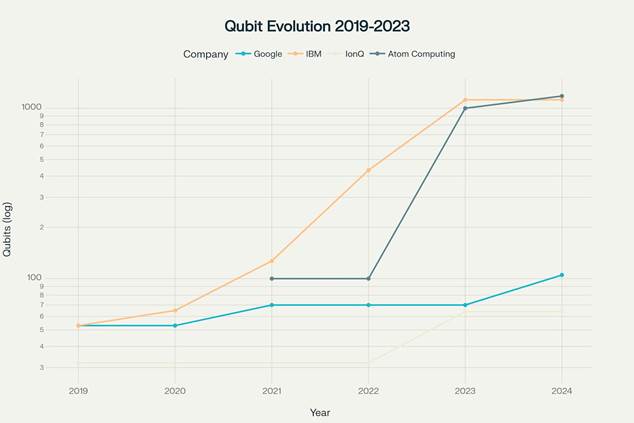

Évolution du nombre de qubits des principaux acteurs de l’informatique quantique (2019-2024)

Les différentes approches technologiques offrent des compromis différents en termes de connectivité . Les ions piégés permettent des interactions plus flexibles mais à des vitesses plus lentes, alors que les qubits supraconducteurs offrent des opérations rapides mais avec une connectivité limitée.

Applications Actuelles et Futures

La Révolution Médicale et Pharmaceutique

L’industrie pharmaceutique représente l’un des domaines les plus prometteurs pour l’application des ordinateurs quantiques. La découverte de nouveaux médicaments implique la simulation d’interactions moléculaires complexes qui dépassent les capacités des ordinateurs classiques. Les ordinateurs quantiques, en exploitant leur capacité à simuler naturellement les systèmes quantiques, pourraient révolutionner ce processus.

La société française Qubit Pharmaceuticals illustre parfaitement cette application. Cette entreprise utilise des algorithmes quantiques pour accélérer la conception et la validation de nouvelles molécules thérapeutiques. Grâce à leur plateforme de calcul quantique, ils peuvent être « beaucoup plus créatifs et aller plus vite dans la découverte de médicaments ».

La modélisation quantique permet de comprendre les interactions entre médicaments et organismes à un niveau de détail impossible avec les méthodes classiques. Cette capacité pourrait conduire à des traitements plus efficaces et personnalisés, réduisant considérablement le temps et les coûts de développement pharmaceutique

Intelligence Artificielle et Apprentissage Automatique

L’intersection entre intelligence artificielle et informatique quantique ouvre des perspectives fascinantes. Les ordinateurs quantiques pourraient accélérer significativement l’entraînement des modèles d’IA en exploitant leur capacité de traitement parallèle massif Cette synergie pourrait permettre de développer des intelligences artificielles beaucoup plus sophistiquées.

Les algorithmes d’optimisation quantique sont particulièrement prometteurs pour résoudre les problèmes complexes rencontrés en machine learning. La recherche d’hyperparamètres optimaux, l’optimisation de réseaux de neurones et la classification de données massives pourraient tous bénéficier de l’avantage quantique.

Google a déjà commencé à intégrer des techniques quantiques dans ses recherches en IA. Leur puce Willow pourrait servir de base pour développer des algorithmes d’IA quantiques révolutionnaires. Cette approche pourrait conduire à des percées majeures dans la compréhension et la génération de langage naturel.

Simulation et Modélisation Scientifique

La simulation de systèmes complexes représente un domaine d’application naturel pour les ordinateurs quantiques. Les phénomènes météorologiques, par exemple, impliquent une multitude de variables interconnectées qui évoluent de manière chaotique . Les ordinateurs quantiques pourraient permettre des prévisions météorologiques beaucoup plus précises et à plus long terme.

La recherche en matériaux bénéficierait également énormément de la puissance de calcul quantique. La conception de nouveaux supraconducteurs, de batteries plus efficaces ou de matériaux pour l’énergie solaire nécessite la compréhension de phénomènes quantiques à l’échelle atomique. Les ordinateurs quantiques pourraient accélérer considérablement ces recherches.

La fusion nucléaire, souvent considérée comme le Saint Graal de l’énergie propre, pourrait également bénéficier de l’informatique quantique. La modélisation des plasmas à haute température et des champs magnétiques complexes nécessaire pour contrôler la fusion représente un défi computationnel idéal pour les machines quantiques.

Cryptographie et Sécurité

Paradoxalement, alors que les ordinateurs quantiques menacent la cryptographie actuelle, ils offrent également de nouvelles solutions de sécurité. La cryptographie quantique exploite les propriétés fondamentales de la mécanique quantique pour créer des systèmes de communication théoriquement inviolables.

Le principe de la distribution quantique de clés repose sur le fait que toute tentative d’interception modifie nécessairement l’état quantique du message. Cette propriété permet de détecter instantanément toute tentative d’espionnage. Plusieurs pays ont déjà commencé à déployer des réseaux de communication quantique pour protéger leurs communications les plus sensibles.

Le développement de la cryptographie post-quantique représente également un enjeu majeur. Cette nouvelle génération d’algorithmes cryptographiques est conçue pour résister aux attaques des ordinateurs quantiques futurs. La transition vers ces nouveaux standards cryptographiques est déjà en cours dans de nombreuses organisations.

L’État Actuel de la Technologie

Les Leaders Industriels

Le paysage de l’informatique quantique est dominé par plusieurs acteurs majeurs, chacun poursuivant des approches technologiques différentes. Google, avec sa puce Willow annoncée en décembre 2024, revendique des avancées significatives en correction d’erreurs quantiques. Cette puce de 105 qubits représente un progrès important par rapport à leur précédent processeur Sycamore.

IBM maintient sa position de leader avec sa roadmap ambitieuse et ses processeurs de plus de 1000 qubits.

L’entreprise se concentre sur l’évolutivité et la création d’écosystèmes logiciels pour faciliter l’adoption de l’informatique quantique. Leur approche modulaire permet d’interconnecter plusieurs processeurs quantiques pour augmenter la puissance de calcul.

Des entreprises comme IonQ se distinguent par leur technologie d’ions piégés, offrant des qubits de très haute qualité mais en nombre plus limité. Cette approche privilégie la fidélité des opérations quantiques plutôt que le nombre brut de qubits. D’autres acteurs comme Atom Computing explorent les atomes neutres, une technologie prometteuse pour l’évolutivité future.

Les Avancées Récentes

L’année 2024 a marqué plusieurs percées importantes dans le domaine quantique. La création de nouveaux matériaux supraconducteurs aux États-Unis pourrait améliorer significativement les performances des qubits. Ces matériaux permettent des cycles d’opération plus rapides et plus fiables.

Les progrès dans l’interconnexion de puces quantiques représentent également une avancée majeure. Cette capacité à faire communiquer plusieurs processeurs quantiques ouvre la voie vers des systèmes à très grande échelle. Ces développements sont essentiels pour atteindre le nombre de qubits nécessaire aux applications pratiques.

L’amélioration des techniques de correction d’erreurs, illustrée par les résultats de Google avec Willow, marque un tournant vers des ordinateurs quantiques plus fiables. Ces avancées suggèrent que nous nous rapprochons de l’ère des ordinateurs quantiques véritablement utiles.

Les Limitations Actuelles

Malgré ces progrès, les ordinateurs quantiques actuels restent dans ce qu’on appelle l’ère NISQ (Noisy Intermediate-Scale Quantum). Ces systèmes intermédiaires sont encore trop imparfaits et bruyants pour atteindre leur plein potentiel. Les taux d’erreur, bien qu’en amélioration constante, restent élevés par rapport aux standards requis pour des applications pratiques.

La durée de cohérence des qubits, même dans les meilleurs systèmes actuels, se mesure en microsecondes ou millisecondes. Cette fenêtre temporelle extrêmement courte limite la complexité des algorithmes quantiques qui peuvent être exécutés. L’extension de ces temps de cohérence reste un défi technique majeur.

L’environnement d’exploitation des ordinateurs quantiques constitue également une limitation importante. Le besoin de refroidissement cryogénique, de systèmes de contrôle ultra-précis et d’isolation électromagnétique rend ces machines extrêmement coûteuses et complexes à opérer.

Perspectives d’Avenir et Prédictions

L’Horizon des 10 Prochaines Années

Les experts prévoient des avancées significatives dans la prochaine décennie. Microsoft, par l’intermédiaire de Krysta Svore, responsable du développement quantique, estime qu’un ordinateur quantique véritablement utile pourrait voir le jour d’ici moins de 10 ans. Cette machine serait capable d’effectuer un million d’opérations quantiques par seconde.

L’amélioration des matériaux et des techniques de fabrication devrait permettre d’augmenter considérablement la durée de cohérence des qubits. Des innovations comme les qubits topologiques, actuellement en phase de recherche fondamentale, pourraient offrir une protection naturelle contre la décohérence.

Le développement de l’informatique quantique distribuée représente également une tendance majeure. L’interconnexion de multiples processeurs quantiques via des liens quantiques pourrait permettre de créer des superordinateurs quantiques d’une puissance inimaginable.

Impact Sociétal et Économique

La révolution quantique aura des répercussions profondes sur l’économie mondiale [7][9][35]. Des secteurs entiers pourraient être transformés, depuis la finance avec l’optimisation de portefeuilles complexes, jusqu’à la logistique avec la résolution de problèmes d’optimisation à grande échelle [7][9][35]. Cette transformation créera de nouveaux emplois tout en rendant certaines compétences obsolètes.

La sécurité informatique connaîtra une révolution majeure avec l’avènement d’ordinateurs quantiques capables de casser les systèmes cryptographiques actuels. Cette transition, appelée « Y2Q » (Years to Quantum), nécessitera une préparation massive des infrastructures numériques. Les organisations doivent dès maintenant commencer leur migration vers des solutions cryptographiques post-quantiques.

L’accès démocratique à la puissance de calcul quantique via le cloud computing pourrait niveler le terrain de jeu technologique. Des startups et des chercheurs du monde entier pourraient accéder à des capacités de calcul auparavant réservées aux plus grandes entreprises.

Les Défis Éthiques et Réglementaires

Le développement de l’informatique quantique soulève des questions éthiques importantes. La capacité de casser les systèmes cryptographiques actuels pose des défis majeurs pour la protection de la vie privée et la sécurité nationale. Les gouvernements devront établir de nouveaux cadres réglementaires pour gérer ces technologies sensibles.

L’inégalité d’accès à la technologie quantique pourrait creuser le fossé technologique entre pays développés et en développement. Il sera crucial de développer des stratégies pour démocratiser l’accès à ces technologies révolutionnaires.

La formation et l’éducation représentent également des enjeux majeurs. Le développement d’une main-d’œuvre qualifiée en informatique quantique nécessitera des investissements massifs dans l’enseignement et la recherche. Des universités du monde entier commencent déjà à intégrer des cours de physique quantique et d’informatique quantique dans leurs cursus.

Conclusion : Vers un Futur Quantique

L’ordinateur quantique représente bien plus qu’une simple évolution technologique ; c’est une révolution fondamentale dans notre façon de traiter l’information. En exploitant les propriétés étranges et fascinantes de la mécanique quantique, ces machines promettent de résoudre des problèmes qui resteront à jamais hors de portée des ordinateurs classiques.

Le chemin vers cette révolution quantique est semé d’embûches techniques considérables. La décohérence, les erreurs quantiques et les défis d’évolutivité représentent autant d’obstacles que les chercheurs et ingénieurs s’efforcent de surmonter. Cependant, les progrès récents, notamment avec la puce Willow de Google, montrent que ces défis ne sont pas insurmontables.

Les applications potentielles de l’informatique quantique toucheront tous les aspects de notre société . De la découverte de nouveaux médicaments à la résolution du changement climatique, en passant par le développement d’intelligences artificielles révolutionnaires, ces machines pourraient transformer notre monde de manière imprévisible .

Nous nous trouvons aujourd’hui à l’aube de cette révolution quantique. Les ordinateurs quantiques d’aujourd’hui, bien qu’imparfaits, posent les fondations d’une nouvelle ère technologique . Dans les décennies à venir, ces machines pourraient bien redéfinir les limites du possible et ouvrir des horizons scientifiques que nous ne pouvons qu’imaginer .

L’aventure quantique ne fait que commencer, et elle promet d’être l’une des plus extraordinaires de l’histoire humaine . Préparer notre société à cette révolution, former les esprits de demain et établir les cadres éthiques appropriés constituent les défis immédiats que nous devons relever pour exploiter pleinement le potentiel de cette technologie révolutionnaire .